Information retrieval e RAG

Il Webinar fa parte del Programma Tematico:

Artificial Intelligence: nuove frontiere e opportunità per le imprese (2025)

Descrizione del Webinar

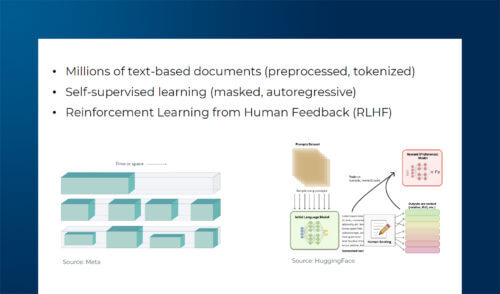

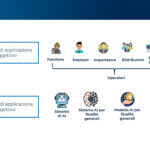

Negli ultimi anni osserviamo sempre più grande attenzione nei confronti dei Large Language Models (LLM), alla base del funzionamento di strumenti conversazionali di AI Generativa. La Retrieval-Augmented Generation (RAG) combina gli LLM con meccanismi di recupero per migliorare i loro output. Integrando knowledge base esterne, i sistemi RAG possono accedere a informazioni aggiornate e specifiche, migliorando la rilevanza e l’accuratezza delle loro risposte.

In questo webinar esploreremo i fondamenti degli LLM e dei RAG, esaminandone le funzionalità, i benefici e le sfide. Inoltre, discuteremo sulle loro applicazioni e su come queste tecnologie stanno plasmando il futuro delle soluzioni guidate dall’intelligenza artificiale

Domande chiave

- Cosa sono i LLMs e come funzionano?

- Cosa si intende per RAG e quando si utilizza?

- Quali sono i vantaggi dell’utilizzo di un sistema RAG?

Relatori

Francesco Pierri

Assistant Professor, Politecnico di MilanoAssistant Professor, Politecnico di Milano

Siamo a tua disposizione per informazioni e assistenza

Martina Vertemati

Acquisti e abbonamenti Da Lunedì al Venerdì, dalle 09 alle 18

Alessia Barone

Assistenza Da Lunedì al Venerdì, dalle 09 alle 18Scopri altri contenuti di Artificial Intelligence

Aggiungi in Agenda

Scegli la modalità di partecipazione